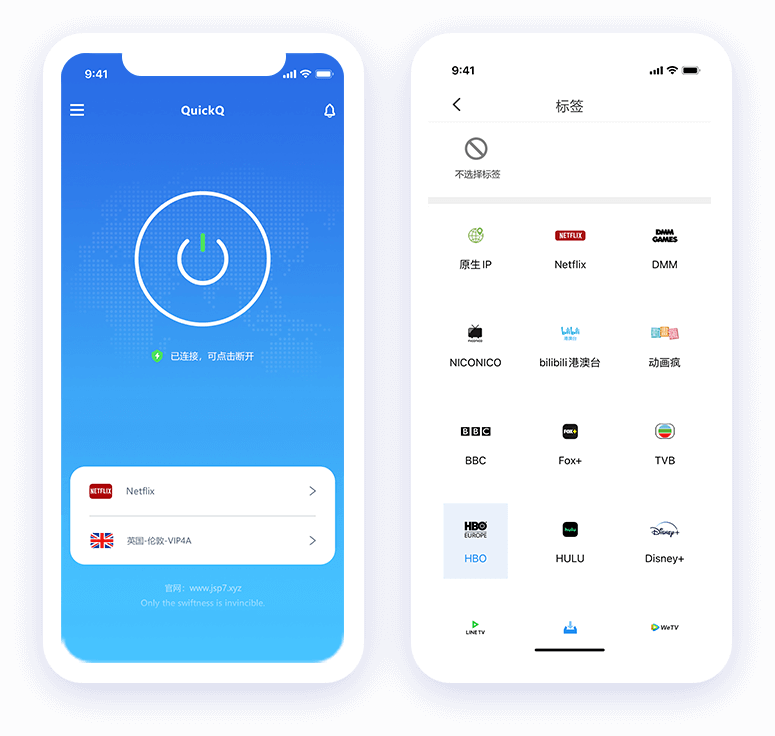

QuickQ能通过智能选路、专用节点、协议优化与压缩并行等手段,缩短跨国链路往返时间、提高吞吐、降低丢包,从而加速数据仓库的ETL、备份与实时复制等流程,适用于云上跨区访问与本地到云的海量数据传输场景。

先讲结论,然后慢慢拆解(用费曼法)

一句话:要让数据仓库跑得快,不是只靠更强的服务器,而是把“网”弄顺。QuickQ的作用就是把网络这段路变短、更稳、更聪明。下面我会先把整体原理讲清楚,再分场景、给可执行的配置建议、测试方法和故障排查思路,像跟朋友唠嗑一样讲明白。

为什么网络对数据仓库特别重要?

想像一下:数据仓库像仓库里的拣货台,ETL像把货搬到台面去,BI查询像客户来取货。无论货架多好、工人多快,如果路窄车慢,效率还是不好。网络决定了数据从存储到计算节点、从源到目标的传输速度与可靠性——尤其是跨区、跨国、跨云的场景,网络延迟(RTT)、抖动和丢包会把原本几分钟的任务拖成几十分钟甚至失败。

关键网络指标

- 带宽:理论每秒能传多少数据。

- 吞吐(Throughput):实际可用带宽,受延迟/丢包/并发影响。

- 延迟(RTT):影响往返通信与短请求的响应速度。

- 抖动/Jitter:延迟不稳定会影响流式复制与实时处理。

- 丢包率:丢包会触发重传,吞吐下降。

QuickQ用哪些技术来“加速”数据仓库?

QuickQ并不是魔法,但它把一系列网络优化组合起来,像把几件工具放到同一个工具箱里,配合使用能产生乘数效应。

1)智能路由与最短路径选择

QuickQ会根据实时网络状况选取最优转发路径(少跳、绕开拥塞链路),类似高速路上选最快的车道。对于跨境访问,能显著缩短RTT和避免损耗严重的中间链路。

2)专用节点与地域就近接入

QuickQ在全球部署加速节点(或专线/直连),可以把网络的“最后一公里”或“最后几百公里”变得更稳、更快。对于访问云数据仓库(如跨区连接到Redshift、BigQuery、Snowflake等),选择就近/同区域节点能减少多段公网转发。

3)协议优化(TCP加速、UDP或多路径)

传统TCP在高延迟高丢包环境下效率很差。QuickQ通过优化拥塞控制、窗口调整、避免慢启动、启用多连接并行或多路径传输(Multipath TCP、并行SST)来提高吞吐。

4)压缩与去重(WAN优化)

对于重复数据或可压缩数据(CSV、JSON、文本元数据等),传输前压缩或做内容去重能大幅降低要传输的数据量。快得多,但对不可压缩的二进制格式(已压缩的Parquet/ORC)效果有限。

5)缓存与预读

对于频繁读取的元数据或小文件,节点缓存可以避免重复跨境读取。预读机制在批量读取时也能把延迟隐藏(提前拉取下一批数据)。

6)安全与加密协同优化

所有传输同时保留加密(TLS),但QuickQ把握好加密与性能的折中,比如采用硬件加速的加密、会话复用来减少握手开销。

典型场景与具体优化策略

场景 A:跨国ETL作业(大文件同步/加载)

问题:每天需要把数百GB或TB级的数据从源站同步到云仓库,传统SCP/S3跨区上传慢且易中断。

- 怎么做:使用QuickQ的并行传输+压缩+专用节点,将传输任务拆成多路并行任务(分片上传),并在网络层启用重试与断点续传。

- 配置要点:启用多连接(比如并行4-16个流),设置MTU合理(避免额外分片),使用增量同步而不是全量(只传变化)。

- 效果预期:带宽利用率提升数倍,传输失败率下降,整体ETL窗口缩短。

场景 B:跨区交互式查询(BI仪表盘)

问题:BI仪表盘请求很多小交互(SQL小查询),单次延迟直接影响用户体验。

- 怎么做:优先降低RTT:就近接入、智能路由;同时启用会话复用加速握手。

- 配置要点:对BI客户端使用分流策略(只把库的请求走加速通道),保证低抖动与高可用节点。

- 效果预期:查询响应时间显著下降,用户体验更流畅,BI刷新频率可提高。

场景 C:实时复制/流式更新(CDC)

问题:复制需要低延迟和高可靠性,偶发丢包会造成延迟回退或一致性问题。

- 怎么做:使用QuickQ的流控优化与丢包恢复,结合应用级ACK和顺序保障机制。

- 配置要点:优先保证连接稳定、开启流量优先级(QoS),并对关键流量设静态路由。

- 效果预期:抖动和丢包导致的延迟降到最低,复制滞后时间可控。

部署与配置实操(可直接落地的步骤)

下面是把QuickQ用于数据仓库加速的一个常见部署流程(按步骤来,不要着急):

- 评估流量与端点:把数据仓库、ETL服务器、存储端点的IP/CIDR、域名列清楚,标注流量类型(批量/交互/流式)。

- 选择接入方式:QuickQ支持系统级VPN、代理(SOCKS5/HTTP)、或网关/边缘代理。对大数据传输推荐网关或系统级,以获得全流量优化。

- 配置分流规则:把数据仓库相关IP段列入加速列表(split-tunnel),避免不相关流量占用加速资源。

- 启用并行与压缩:在QuickQ客户端/网关上启用并行传输与LZ4/Zstd类压缩,针对不可压缩格式考虑关闭压缩以节省CPU。

- 调整MTU与TCP参数:在服务器和网关上调整MTU(避免中间链路分片),根据链路延迟调整TCP窗口和拥塞策略。

- 测试并量化:使用iperf、ping、traceroute,及ETL作业前后的实际传输时间对比来验证效果。

- 监控与告警:配置吞吐、RTT、丢包率、会话数监控与告警,长期观察性能波动。

示例:Linux服务器通过QuickQ网关加速S3到Redshift数据加载

- 在ETL服务器上安装QuickQ客户端,配置到最近的加速节点并开启系统路由模式。

- 在QuickQ控制台添加Redshift所在VPC的CIDR到加速白名单(或建立专线直连)。

- 在ETL工具(如Airflow任务)中,将大文件上传分片并行,并指定HTTP Keep-Alive与多线程上传。

- 运行前后对比:记录上传秒/GB与Redshift COPY的完成时间。

参数与推荐值(按场景快速参考表)

| 场景 | 推荐并行度 | 压缩 | MTU | 备注 |

| 大文件批量同步 | 8-16 | 开启(对可压缩格式) | 1400-1500 | 并行分片+断点续传 |

| BI交互式查询 | 1-4 | 可选(cpu/延迟权衡) | 1500 | 优先低RTT与会话复用 |

| 实时复制/CDC | 1-8(取决于流) | 通常关闭 | 1450-1500 | 保证丢包恢复与低抖动 |

如何验证QuickQ带来的提升(测量方法)

别只看感觉,要量化。下面是几个可靠的测量方法,按顺序做能清晰看到效果。

- 基线测试:在接入QuickQ前记录ping(RTT)、iperf吞吐、traceroute路径和ETL作业完成时间(多次取中位数)。

- 启用QuickQ:用相同时间窗口复测相同指标,注意尽量在网络条件相近时做对比。

- 应用层测量:记录SQL查询平均响应时间、批量加载时间(秒/GB)、失败重试次数。

- 长期监控:观察一周或更长周期的数据,看高峰/低谷时性能是否稳定。

常见误区与限制(别被绕晕了)

- 误区:加速器能无限提升带宽。不行。最后的瓶颈可能是磁盘IO、目标仓库的并发处理能力、或已经压缩不可再压缩的数据。

- 误区:所有流量都应该走VPN。不一定。把非关键流量入加速会造成资源浪费,分流策略更聪明。

- 限制:对压缩格式效果有限。Parquet/ORC/Avro等已经压缩的格式,传输层压缩收益小。

- 合规和安全:跨境数据传输要注意合规,使用加密与日志审计。

故障排查思路(快速定位问题)

遇到加速后并未改善或变慢,按这个思路排查:

- 先看网络指标:ping/icmp/iperf。是否带宽或RTT反而升高?

- 查看路径:traceroute是否走了意外绕行或进入了错误节点。

- 检查并发与连接数:是否有过多短连接导致TCP建立成本高。

- 确认CPU与加密负载:启用压缩或加密可能增加CPU,反而拖慢传输。

- 回滚测试:临时关闭QuickQ,看性能是否回到原先,帮助判断问题是否来自加速器配置。

平台与集成建议(Windows/macOS/Linux/容器/移动)

数据仓库加速多落在服务器端和网关层。QuickQ支持多平台,但实践中:

- 服务器(Linux/Windows Server):建议使用系统级或网关级加速,配置split-tunnel针对目标IP段。

- 容器化环境(Kubernetes):在边车(sidecar)或节点网关上部署加速代理,避免在每个容器里重复安装。

- 开发/分析终端(Windows/macOS):用客户端模式或代理来加速交互式查询与小规模测试。

- 移动设备:通常不用于大数据传输,但可用于运维访问和小规模测试。

安全、合规与成本考虑

加速并非零成本,既有流量费/节点费,也有合规限制:

- 成本:专用节点或更高吞吐套餐会产生额外费用,要评估每GB节约的时间价值。

- 安全:保证端到端加密、会话控制、访问审计。避免把敏感数据暴露到未经认证的节点。

- 合规:跨境传输须遵循当地数据保护法规(如个人信息、金融数据等)。

实战小贴士(写给工程师的短清单)

- 先测再改:做基线性能记录。

- 分流关键流量:只把数据仓库流量走加速。

- 并行+断点续传:大量文件时效果最佳。

- 调节压缩:对文本启用,对已压缩格式关闭。

- 监控要到位:吞吐、RTT、丢包、会话数都要看。

- 留备选方案:出现问题能快速回退到原生网络。

几个真实例子(不夸张的场景)

有家公司每天把几个TB日志从欧洲同步到美国的Snowflake,原来用公网S3上传常常超出维护窗口。引入QuickQ后,他们把上传并行化、启用压缩与专用节点,ETL窗口从8小时降到2.5小时,失败率也从10%降到1%左右(这是典型收益,但具体数值取决于链路)。另一个是跨国电商,BI仪表盘刷新时间从平均3.2秒降到1.1秒,用户感受显著改善。

结尾前的随想:什么情况下不必过度依赖加速器?

嗯——如果你的仓库和计算都在同一可用区,内部网络已经非常快,那么再加速公网意义不大;或者你的瓶颈是SQL优化、索引或存储IO,那么先把这些做了,网络优化只是最后一环。总之,先找瓶颈,再投资源,这样更划算。

如果你准备动手,不妨先把关键路线的IP列出来,做一次基线测试,然后按上面的步骤逐步引入QuickQ,监控数据会告诉你是否值得继续投入。我这边还想到不少细节,但现在先写到这儿,边写边回想,可能还有个别点漏了,回来补充也可以。